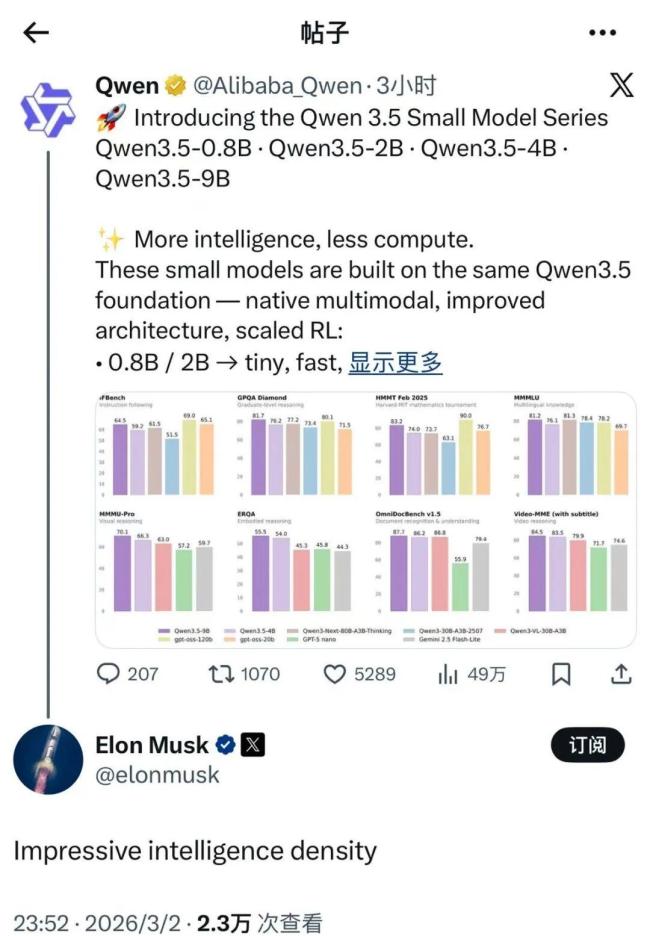

马斯克再度为中国AI点赞。3月2日深夜,阿里『通义千问』团队在X平台正式发布Qwen3.5小模型系列,覆盖0.8B、2B、4B和9B四个规格,发布后迅速引发海外科技圈关注。埃隆·马斯克第一时间在该推文下评论:“Impressive intelligence density”(令人印象深刻的智能密度)。

这一认可让国产大模型获得更多国际关注。除了马斯克,Gemini Cli产品负责人Dmitry Lyalin等业界人士也纷纷点赞,各国开发者积极测试,千问成为全球AI圈的热门话题。

很多人好奇,马斯克口中的“智能密度”到底是什么?这几款小模型凭什么引发关注?阿里千问团队给出答案:“更强的智能,更少的算力。”打破“参数越大、智能越强”的固有认知,用更少算力和参数量实现数倍乃至十数倍大模型的性能,这便是“智能密度”的核心含义。

这份出色的效率源于千问3.5的技术突破。四款小模型采用统一架构,天生支持文本、图像等多模态交互,经过专门优化,核心优势是“不做无用功”,只调动完成任务所需资源,既保证速度又节省算力。与其他模型不同,它从底层就将文本、图像、视频一起训练,而非事后添加视觉功能,因此在图片识别、文档解读等任务上表现远超同类型轻量模型,还能在“快速响应”和“深度思考”间自由切换。

四款小模型定位清晰、适配全场景:0.8B和2B体积极小,可直接在普通手机、物联网设备上运行,其中0.8B语言表现一般但视觉任务表现超出预期,2B的视觉能力更出色;4B可在手机、平板上流畅运行,适合中小企业作为轻量智能底座;9B性能更强,能在普通Mac上运行,综合性能超越参数量三倍的上一代模型,可比肩同类顶级模型,初步缩小了与前沿大模型的差距。

海外开发者对其评价积极,有开发者认为不应仅凭“小模型”的定位来低估其能力。更直观的是性价比:如今只需3万美元💵的硬件就能实现一年前20万美元💵GPU配置的推理效果。已有开发者演示在iPhone 17 Pro上运行Qwen3.5-2B,可实时完成视觉问答任务;9B模型性能可媲美120B的ChatGPT开源版,体积仅为其十三分之一,且完全免费,可在普通笔记本📓电脑💻️上运行。

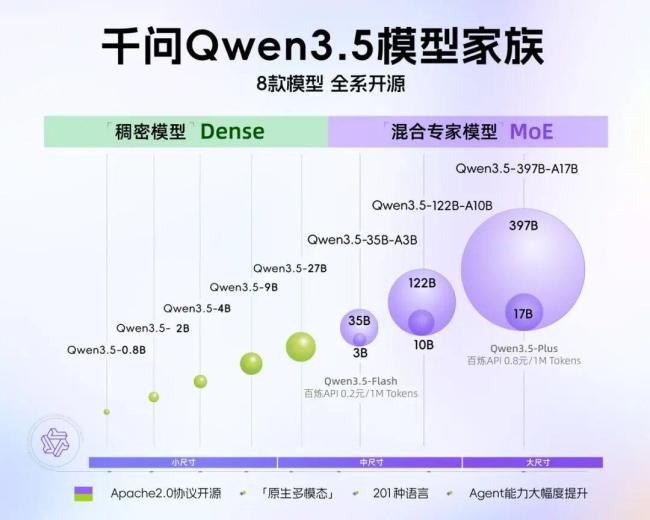

目前,知名开源工具Ollama已官宣支持千问3.5全系,一行命令即可调用;模型也已上线HuggingFace,方便全球开发者下载。千问系列长期坚持开源,迄今已开源400多款模型,涵盖语言、编程、视觉等多个领域,其中千问3.5家族已开源8款模型,均具备“以小胜大”特点,小尺寸接近中型模型性能,中型尺寸可媲美顶级模型。千问曾包揽HuggingFace全球开源模型榜前四,成为众多企业的AI基座,『英伟达』CEO黄仁勋等硅谷人士也多次公开肯定其技术实力。

千问的开源路线让更多人受益——原本高成本的AI模型如今能被更多资源有限的研究者、开发者使用,降低了AI创新的门槛。普通用户也能轻松体验:通过PocketPal AI手机应用,可直接下载运行千问3.5,无需API,全程在设备端完成,英文界面可切换中文。只需注意根据手机可用内存选择模型版本,避免卡顿和闪退即可。

千问3.5的走红标志着大模型行业告别“比参数、拼大小”的“力大砖飞”时代,迈入“实用落地”新赛道。小模型是未来AI硬件的核心,阿里已将千问小模型应用于AI眼镜👓等设备,实现毫秒级视觉解析,解决云端大模型的延迟痛点,“端侧+云端”的结合有望成为未来计算平台的主流形态,无论是消费端视觉智能还是工业领域IoT设备,小模型都是重要基础设施。

未来,千问3.5有望在智能硬件、边缘计算等场景规模化落地,推动AI从“云端专属”走向全民可及,为数字经济转型注入普惠性智能动力。这些小模型体积不大但应用广泛,未来有望渗透到各行各业,国产AI也正凭借此类技术突破在全球AI格局中占据重要地位。